隨著大數據技術的快速發展,Apache Spark 已成為構建高效、可擴展大數據服務的核心產品之一。在面試大數據相關崗位時,深入理解 Spark 的原理、應用及優化策略至關重要。本文將梳理 Spark 的核心面試題,并探討其在構建大數據服務中的應用,為求職者提供全面的準備指南。

一、Spark 核心概念與架構面試題

1. Spark 與 Hadoop MapReduce 的主要區別是什么?

Spark 基于內存計算,通過彈性分布式數據集(RDD)實現高效迭代處理,比基于磁盤的 MapReduce 快數十倍。Spark 提供了統一的批處理、流處理、機器學習和圖計算框架,而 MapReduce 僅專注于批處理。

2. 解釋 Spark 的架構和核心組件。

Spark 采用主從架構,包括:

- Driver Program:運行用戶主程序,創建 SparkContext,負責作業調度與執行。

- Cluster Manager:管理集群資源(如 YARN、Mesos 或 Standalone 模式)。

- Executor:在工作節點上運行任務,負責數據計算與存儲。

- RDD(彈性分布式數據集):Spark 的基本數據結構,具有容錯性和并行處理能力。

3. 什么是 RDD?它的特性有哪些?

RDD 是 Spark 中不可變、分區的數據集合,支持并行操作。特性包括:

- 容錯性:通過血緣關系(Lineage)記錄轉換過程,丟失時可重新計算。

- 惰性求值:轉換操作(如 map、filter)延遲執行,直到遇到行動操作(如 collect、save)才觸發計算。

- 持久化:可緩存到內存或磁盤,加速重復計算。

二、Spark 性能優化與調優面試題

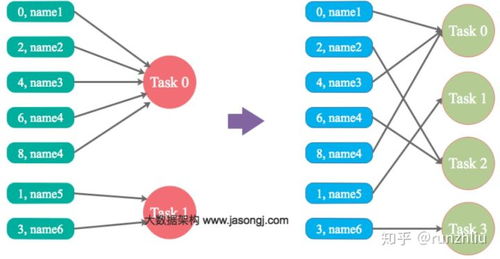

1. 如何避免 Spark 作業中的 Shuffle 操作過度?

Shuffle 是性能瓶頸,優化方法包括:

- 使用

reduceByKey替代groupByKey,在分區內預先聚合減少數據傳輸。

- 增加分區數或調整

spark.sql.shuffle.partitions參數。

- 使用廣播變量(Broadcast Variables)減少小表關聯時的 Shuffle。

2. 解釋 Spark 的內存管理機制。

Spark 內存分為:

- Execution Memory:用于 Shuffle、排序等計算過程。

- Storage Memory:用于緩存 RDD 和數據。

兩者可動態占用,通過 spark.memory.fraction 參數調整比例。合理配置可避免 OOM(內存溢出)錯誤。

- 如何調試 Spark 作業的慢任務?

- 使用 Spark UI 分析各階段執行時間、數據傾斜情況。

- 檢查數據分區是否均勻,可通過

repartition或coalesce調整。

- 監控 GC(垃圾回收)頻率,優化 JVM 參數。

三、Spark 在大數據服務中的應用場景

- 實時數據處理:通過 Spark Streaming 或 Structured Streaming 構建低延遲流處理服務,如實時日志分析、金融風控。

- 數據倉庫與 ETL:利用 Spark SQL 處理大規模結構化數據,替代傳統 Hive 查詢,提升數據清洗和轉換效率。

- 機器學習平臺:集成 MLlib 庫,支持分布式模型訓練與推薦系統構建。

四、實戰準備建議

- 掌握編碼能力:熟練使用 Scala、Python 或 Java 編寫 Spark 作業,重點練習 DataFrame API 和 Spark SQL。

- 理解生態集成:熟悉 Spark 與 Hadoop、Kafka、HBase 等組件的協作方式。

- 模擬場景問題:準備如何設計一個高可用的 Spark 大數據服務,包括故障恢復、資源調度和監控告警策略。

Spark 作為大數據產品的核心,其面試不僅考察理論知識,更注重解決實際問題的能力。求職者應結合項目經驗,深入理解 Spark 的優化技巧和服務化部署,從而在面試中展現全面的技術視野。