合作市電子商務公共服務中心正式揭牌并投入運行,標志著該市電子商務產業發展進入了一個由政府引導、專業服務、資源整合的新階段。該中心的啟動,旨在為全市電商企業、創業者及傳統轉型企業提供一站式、系統化的電子商務運營管理服務,構建區域電商發展的核心支撐平臺。

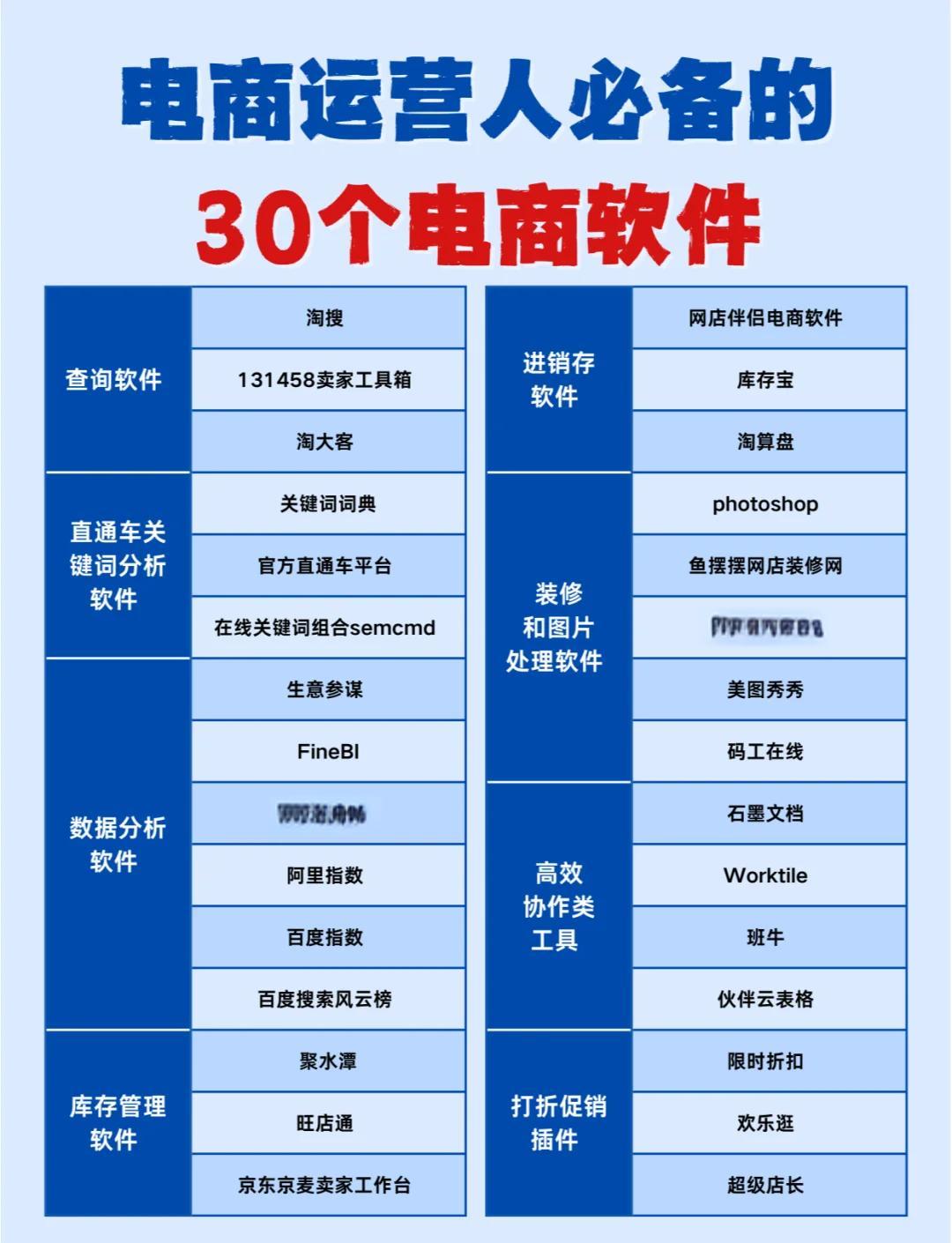

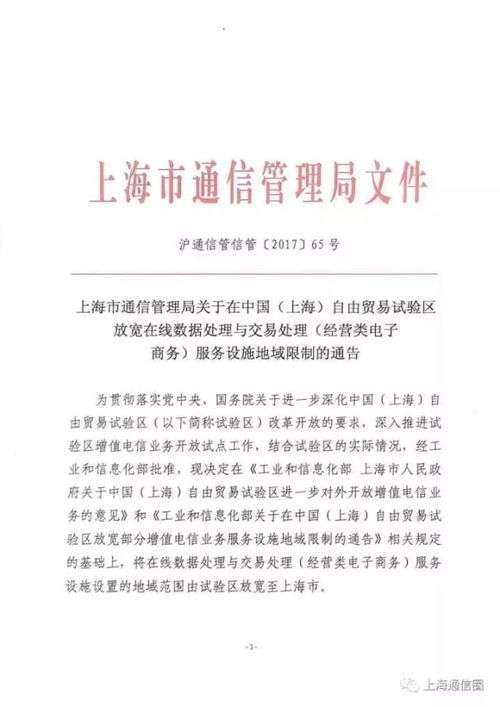

中心集運營指導、技能培訓、資源對接、品牌孵化、技術支持和物流協調等多功能于一體。其核心服務聚焦于電子商務運營管理的全鏈條,包括但不限于:為本地企業提供網店開設、店鋪裝修、視覺設計、營銷推廣(如直播帶貨、社交媒體運營)等實操指導;定期舉辦電商技能培訓班,涵蓋從入門到進階的課程,提升從業者專業素養;搭建產銷對接橋梁,助力本地特色產品(如農牧產品、手工藝品)上行,拓寬銷售渠道;提供數據分析、IT技術支持及合規咨詢,幫助企業優化運營策略、規避風險。

該公共服務中心的成立,是合作市順應數字經濟發展趨勢、落實鄉村振興戰略的重要舉措。它將有效解決本地電商發展中普遍存在的“運營能力弱、資源分散、品牌影響力不足”等痛點,通過集約化、專業化的服務降低創業門檻和運營成本。中心不僅服務于個體網商,也將成為傳統商貿企業數字化轉型的助推器,促進線上線下融合發展。

合作市電子商務公共服務中心計劃進一步整合物流、金融、供應鏈等資源,深化與電商平臺、高校及行業協會的合作,持續完善服務體系。其目標是打造一個充滿活力的本地電商生態圈,培育一批具有市場競爭力的電商主體和區域品牌,從而帶動就業創業,推動產業結構升級,為合作市經濟高質量發展注入強勁的數字化動力。